コラム

「金融庁 AI官民フォーラム」(第3回)議事要旨 を読む

令和7年11月5日に開催された「金融庁 AI官民フォーラム」(第3回)議事要旨が公表されました。

今回は、AI官民フォーラム(第3回)のポイントを追っていきたいと思います。

1 第3回フォーラムの位置づけ

https://www.fsa.go.jp/singi/ai_forum/siryou/3-1.pdf

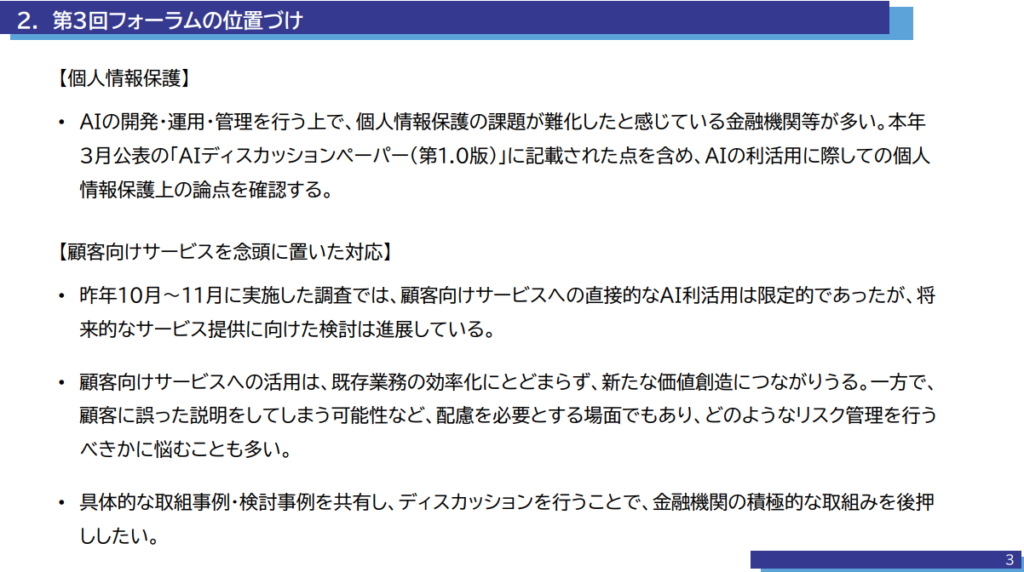

第3回フォーラムでは、まずAIの開発・運用・管理を行ううえでの個人情報保護に関する論点の確認がなされ、そのうえで、顧客向けサービスを念頭に置き、具体的な取り組み事例の紹介がなされました。

2 金融分野におけるAI利用と個人情報

法的な検討深度を分ける視点として、「深い」利用と「浅い」利用という視点が示されました。

- 顧客情報を詳細に分析する「深い」利用

- 個人情報を分析するというよりは、事務文脈で使わざるを得ないという「浅い」利用

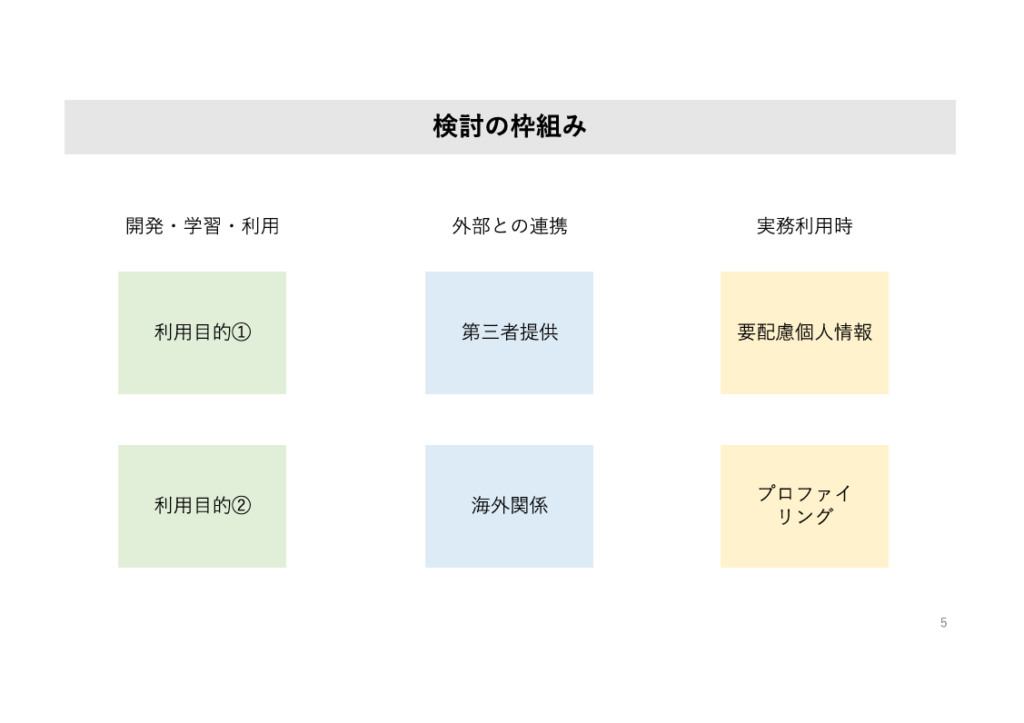

また、検討の枠組みとして「開発・学習・利用」「外部との連携」「実務利用時」という切り口が示されています。

https://www.fsa.go.jp/singi/ai_forum/siryou/3-2.pdf

かかる切り口から、個人情報保護法上の論点について、利用目的の明示や第三者提供の同意取得が重要なポイントとなります。顧客においてその個人情報の利用目的が認識可能なものや従来業務の自動化のようなものであれば、合理的に予測可能と説明できるとされました。

「開発・学習・利用」については、個人情報の利用目的の明示が論点となる。

この点、個人情報保護法のQ&Aでは、統計データへの加工自体を利用目的とする必要はないとされており、一般的・汎用的な分析について確認的に言及したものと捉えられている。個別事情にはよるものの、AIの開発・学習についても、このQ&Aの趣旨に鑑み、利用目的への明記は不要と整理できると考えられる。なお、足元の個人情報保護法改正の議論では、AIによる開発・学習について個人情報の第三者提供の同意取得義務の緩和等についても議論されている。

また、「浅い」利用に関しても利用目的の明確化が必要かという論点について、利用目的の特定を考えるにあたっては、一般に、情報の取扱いを顧客が合理的に予測・想定できるかが重要なポイントとなる。したがって、チャットボットのように顧客において認識可能なものや、従来業務の単なる自動化であれば、合理的に予測・想定可能と評価できると考えられる。https://www.fsa.go.jp/singi/ai_forum/gijiyoshi/20251112.html

特に実務上、管理部門やシステム部門において対応が必要と思われるのは「外部との連携」です。委託先管理や追加学習を防ぐための対応などが主要な論点となります。

次に、「外部との連携」に関しては、AI利用の場合は個人情報の分析等の処理を行う場合が多いため、連携先への個人情報の取扱いの委託に該当する場合が多いと考えられる。この場合、委託先管理や追加学習等の独自利用の制御などの対応が必要となる点に留意が必要である。そうした措置の例示としては、AIディスカッションペーパーの31ページの対応例が参考になる。

https://www.fsa.go.jp/singi/ai_forum/gijiyoshi/20251112.html

このAIディスカッションペーパー31頁の対応というのは、以下の部分です。

これらの課題への対応として、アンケートやヒアリングから確認できた取組みを紹介する。まず、個人情報を生成AIサービスに入力しないことを徹底するために、個人情報保護委員会からの通達を含めて社内の事務連絡文書にて全職員へ注意喚起している先や、顧客情報の入力をシステムで自動的に制限できないか検討を行っている先などが確認された。また、入力したデータが再学習に使われるのを 防ぐために、専用区間を設けてデータが再学習に利用されない環境を構築している先や、外部ベンダーやシステムと連携する際に適切な契約書や覚書を取り交わしてデータの取扱範囲等について明文化している先が認められた。事故やインシデントが発生した場合には速やかにトレースできるようログ管理を徹底している先や、プロンプトの入力内容等の監視運用を効率的かつ正確にできるよう検討していると回答した先もあった。

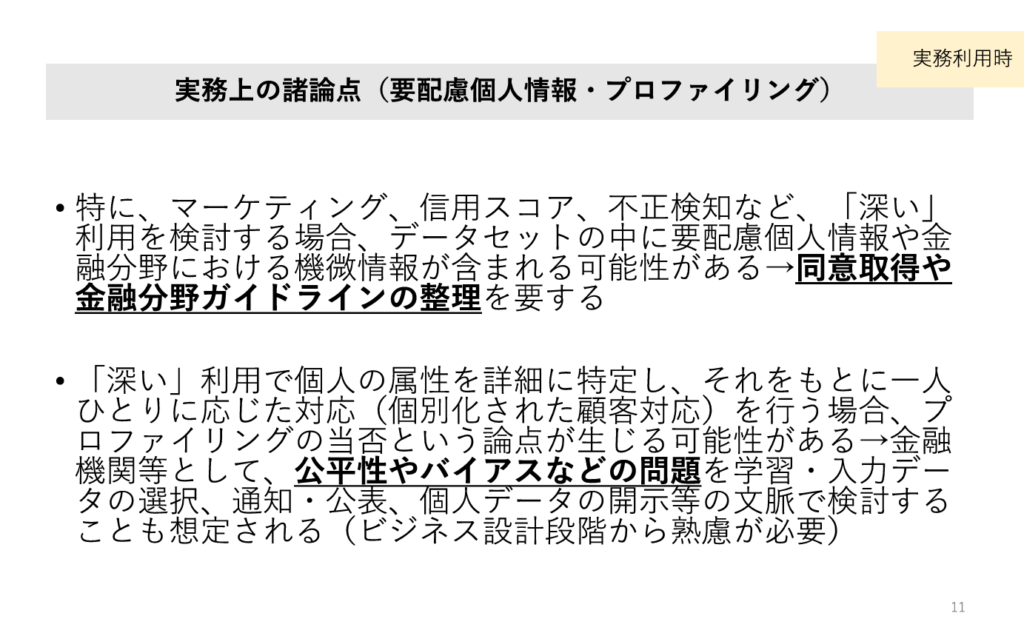

そして、保険ビジネスでも対顧客への利用における重要な点は、「要配慮情報、プロファイリング」の点です。この点について、やはり同意の取得やプロファイリングの設計(公平性やバイアスなどの問題がないか)が大きな問題となります。

https://www.fsa.go.jp/singi/ai_forum/siryou/3-2.pdf

3 アフラックの取り組み

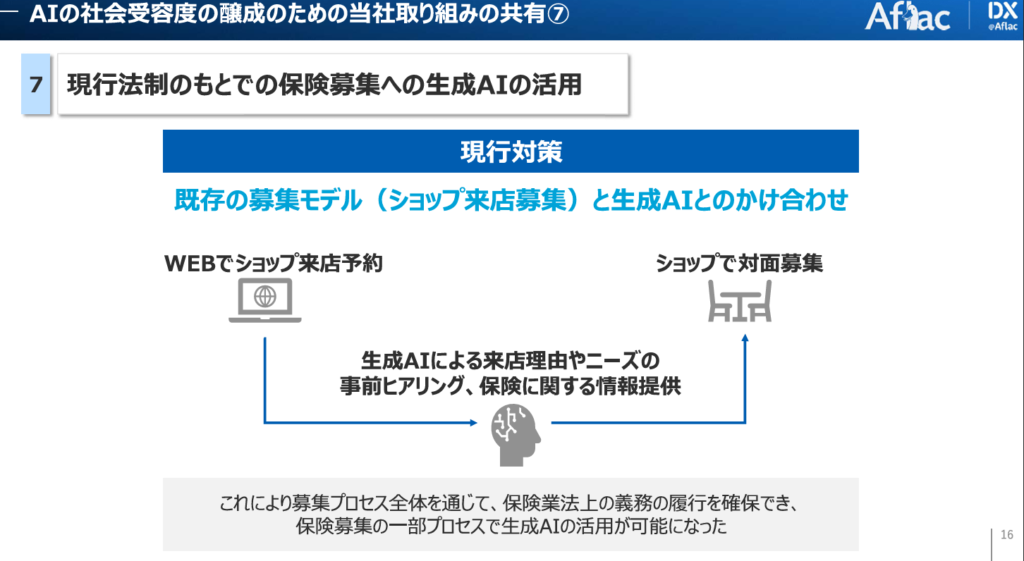

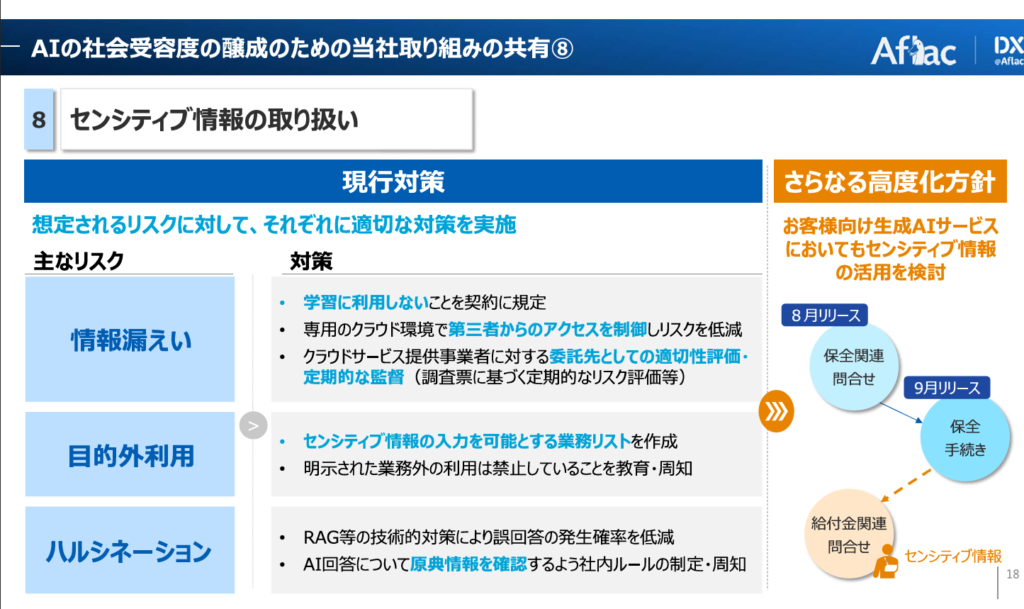

本フォーラムでは、アフラックの取り組みが紹介されました。特に重要なのは保険募集への生成AIの活用とセンシティブ情報の取扱いです。

https://www.fsa.go.jp/singi/ai_forum/siryou/3-2.pdf

現時点では、あくまでも保険募集人のサポートとしての位置づけで、募集活動の効率化に活用されています。

https://www.fsa.go.jp/singi/ai_forum/siryou/3-2.pdf

以下のように述べられており、センシティブ情報の入力を可能とする業務の限定が図られています。まさに、「AIは人を代替するものではなく、業務を代替するもの」であるという実例ではないかと思います。

8点目は、センシティブ情報の取扱いである。生成AIのユースケースによってはセンシティブ情報の利用が必要となるが、情報漏えいや目的外利用等のリスクに対応するため、専用クラウド環境による第三者からのアクセス制御、クラウド事業者に対する委託先としての適正評価や定期的な監査の実施、センシティブ情報の入力を可能とする業務の限定などの対策を講じている。

https://www.fsa.go.jp/singi/ai_forum/gijiyoshi/20251112.html

執筆者プロフィール

- 株式会社Hokanグループ 弁護士/パブリック・アフェアーズ室長

兼コンプライアンス室長

2008年慶應義塾大学法科大学院卒業、2009年弁護士登録(東京弁護士会)。都内法律事務所・損害保険会社・銀行を経て、株式会社hokanに入社。平成26年保険業法改正時には、保険会社内で改正対応業務に従事した経験を持つ。「「誠実義務」が求める保険実務におけるDXの方向性(週刊金融財政事情 2024.9.17)」、「実務担当者のための今日から始める保険業法改正対応」(保険毎日新聞 2025.5.15~7.3)等を執筆。

関連記事

- 2025年12月3日金融庁Discussion Paper Series 保険代理店にかかる海外制度調査-大規模乗合代理店を中心としてを読む

- 2025年11月21日令和7年9月 業界団体との意見交換会において金融庁が提起した主な論点 を読む

- 2025年11月13日代理店業務品質評議会(第3回)議事概要 を読む

- 2025年10月29日第3回代理店業務品質評議会 公表された配布資料を読む

- 2025年10月22日「皆保険の“中核”を守る」時代に、民間保険はどこで価値を出すか

執筆者監修のお役立ち資料

・金融庁出向経験弁護士が答える 「保険業法改正 Q&A一問一答」Part.2book

・2025年監督指針徹底解説 保険代理店の今からできる対応事項book

・金融庁出向経験弁護士が答える 「保険業法改正Q&A一問一答」

・【ハ方式→ロ方式】意向把握 完全移行マニュアル

・弁護士監修 乗合代理店の為の保険業法改正対応の手引き

hokan®︎の資料はこちら!