コラム

インシュアテック企業のインハウスローヤーが読む「AIディスカッションペーパー(第1.0版)」

1 保険業界は「チャレンジしないリスク」をどう乗り越えるか

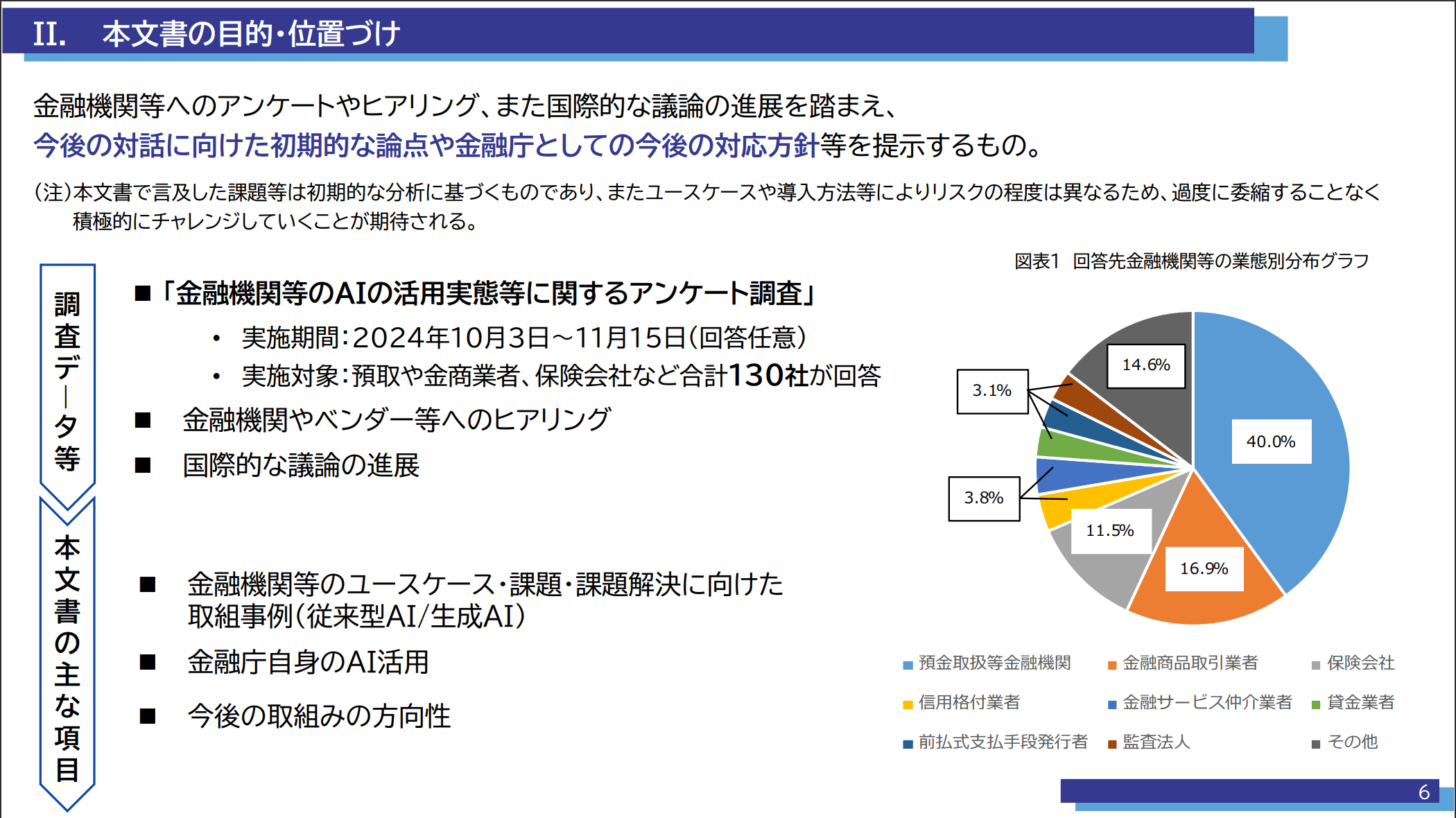

今年3月、金融庁が公表した「AIディスカッションペーパー(第1.0版)」は、金融分野でのAI活用における初期的な論点を整理したものです。概要版でも41p、本文が55pにおよぶ大部の資料ですが、特に読むべき部分は概要版の18p~28pです。

今回は、本書の位置づけを確認しつつ、AIを活用するにあたっての課題と対応の方向性や取り組み事例のうち特に保険業界において念頭に置くべき論点について述べたいと思います。

https://www.fsa.go.jp/news/r6/sonota/20250304/aidp_summary.pdf

保険分野は、近年特に非保険分野への進出などの話題が広く聞かれるようになってきましたが、従来から固有業務に集中するように法体系が整備されており、新技術に対して慎重な姿勢をとりがちです。

同ペーパーで指摘される「チャレンジしないリスク」(ディスカッションペーパー本文 4p)は、保険業界こそ真正面から向き合うべきテーマと感じます。

チャレンジするにあたって念頭に置くべきリスクと、取り組み事例と方向性について示されていますから、まずはこれらのリスクを克服しつつ、ユースケースを増やしていくことが求められます。

2 多数の論点:信頼と説明責任

とりわけ保険業界では、大きな論点として公平性・バイアス、ハルシネーション(幻覚)、説明可能性の担保が大きな論点になります。

①公平性・バイアス

https://www.fsa.go.jp/news/r6/sonota/20250304/aidp_summary.pdf

「従来型 AI でも公平性やバイアスの問題は大きな論点であるが、LLM のように膨大なパラメータを用いる手法では、推論においてなぜ偏りが生じたのかを検証することが一層難しくなる傾向がある。また、十分な学習データが不足する中で学習を行った場合や、利用する学習データ自体が特定の地域や属性に偏った情報を多く含む場合などは、モデルが学習段階でバイアスを強化してしまう危険性もある。こうした構造的な問題により、意図せず差別的な結果を出す可能性が否定できないとの指摘が見られる。」(ディスカッションペーパー本文 29p)

特に公平が重要な要素となる保険では、こういった公平性やバイアスにそもそも課題を抱えていることをふまえ、AIの利用場面をよく検討することが必要となります。たとえばAIが学習したデータに偏りがあると、保険料の算定や引受査定に不公平が生じるリスクがあります。学習データそれ自体の偏りを避けることは不可能であり、構造的な問題であることから、AIの活用に適する場面と適さない場面を慎重に見極めることが必要となります。

②ハルシネーション(幻覚)

https://www.fsa.go.jp/news/r6/sonota/20250304/aidp_summary.pdf

「「ハルシネーション(幻覚)」と呼ばれる、実際のデータに基づかない出力が生成される事象が大きな課題として認識されている。誤った情報を提示したり、信用リスクや法的リスクに直結する回答を誤って生成したりしてしまうと、当該金融機関等の信頼性を損ないかねない。」(ディスカッションペーパー本文 36p)

おそらく、AIの利活用で真っ先に思い浮かぶリスクがこのハルシネーションではないでしょうか。

データが最新のものではなく古い情報が集まっている場合や、参照データの整備が適切になされていない場合(参照データが適切に管理されていること自体が観念できるのかも問題かと思われますが)など、常にこの問題は発生する可能性が否定できません。

業務効率化のためのAI利活用は、最終的な人間の関与を前提とした業務プロセスの構築という取り組み方針ですすめることが議論されており、回答の根拠づけや参照元の情報を一定程度提示することを求めたうえで、信頼の基礎にはやはり人間が最終判断を行うというフローを構築することが想定されます。

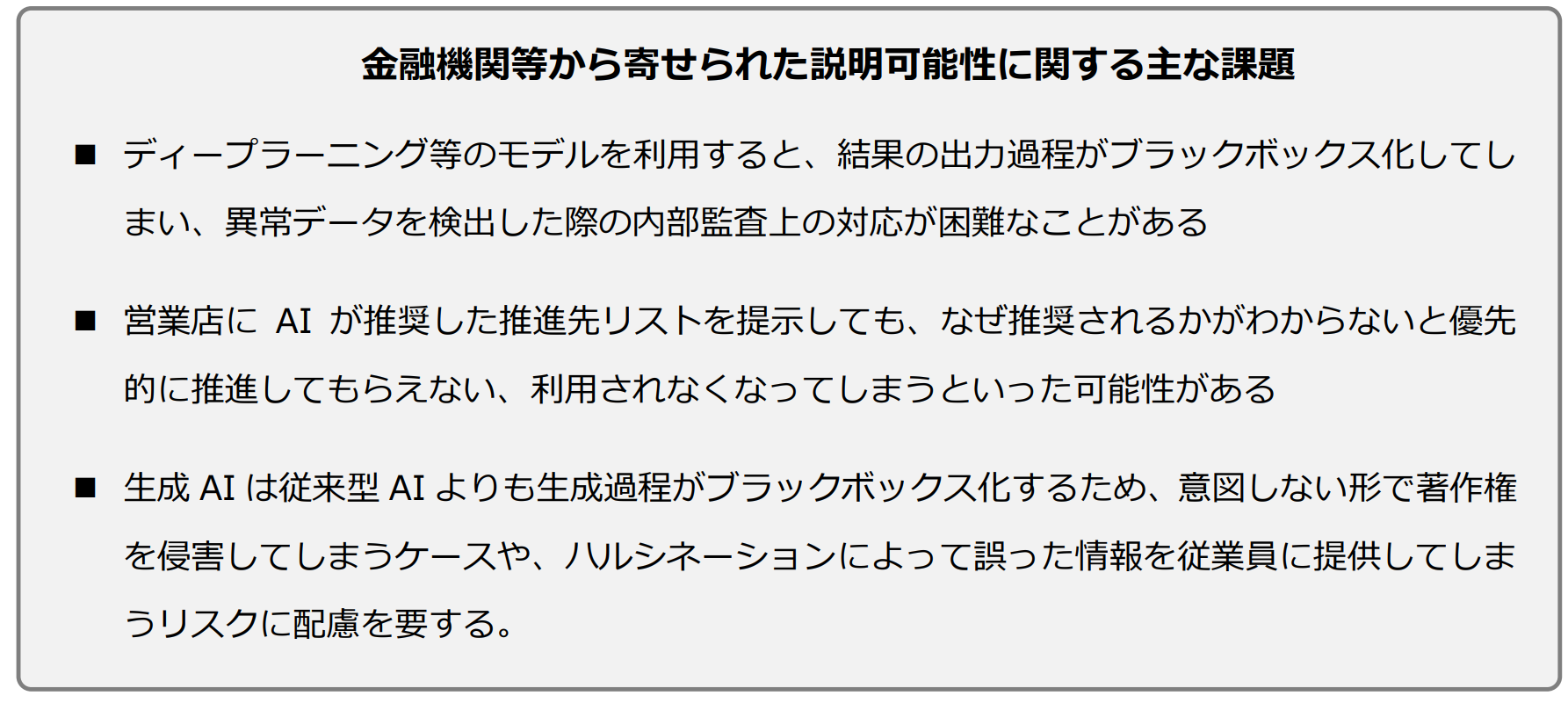

③説明可能性の担保

https://www.fsa.go.jp/news/r6/sonota/20250304/aidp_summary.pdf

(ディスカッションペーパー本文28p https://www.fsa.go.jp/news/r6/sonota/20250304/aidp.pdf)

保険金は適切な時期に必要な顧客に支払われるべきであり、保険会社は相互扶助という公共的に強い社会的責任を負っていますから、社会的信頼が何より大切です。そうすると、保険会社の判断やその業務についての社会的信頼性は、説明がなされること(そして合理的に理解可能であること)によって担保されている面があります。

この点について、AIの回答は、なぜその判断に至ったのか、人間が納得できる形で説明するのは容易ではありません。上記のハルシネーションのリスクと相まって、重大案件には特に懸念が伴います。業務効率化とステークホルダーの納得感の両立について、これから時間をかけて業界全体で構築していくことが求められます。

特に保険業界は当局への説明可能性の担保が重要となります。このディスカッションぺーパー自体が監督当局の設定する初期論点ですから、当然といえば当然なのですが、保険業界のAIの利活用は、「当局を含めた」ステークホルダーの納得感のあるAIの利用が必須となります。

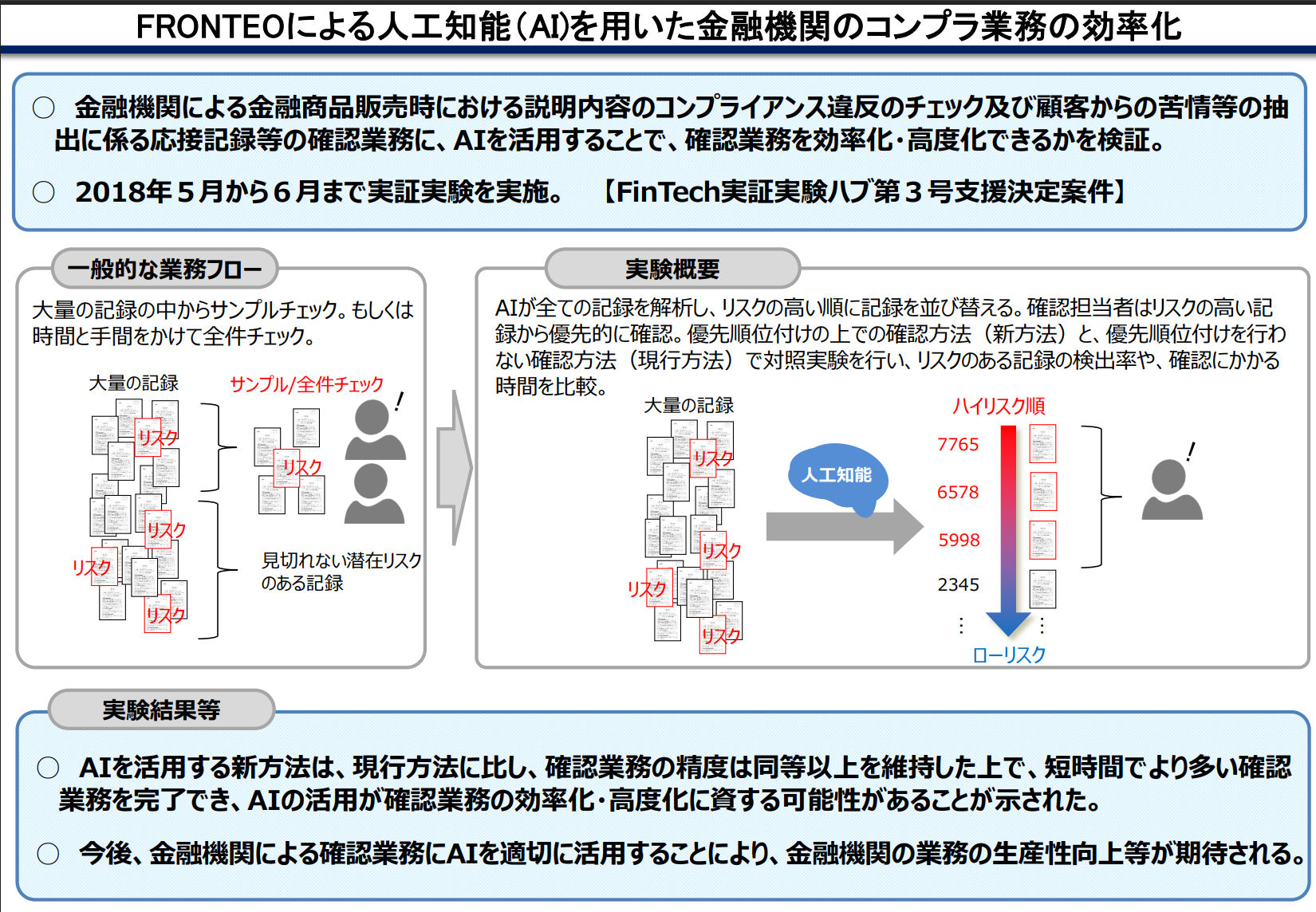

ここで参考になるのが平成30年に行われたコンプラ業務の効率化に関する実証実験です。

https://www.fsa.go.jp/news/30/20180801/01.pdf

この実証実験について、金融庁職員による寄稿記事によればブラックボックスの問題について以下の説明がなされています。

「具体的には、まず説明責任に関する課題である。ディープラーニングを用いた高度な機械学習(ML)モデルの AI は、膨大なデータを学習し自動的に答えを導きだすというメリットがある。一方で、人間が学習の方向性や内容をコントロールできず、AI が導き出した回答の過程を容易に理解できないという問題(ブラックボックス問題)がある。

金融機関は規制当局の検査・監督を受けているため、AI を利用する場合は、法令や監督指針に則した説明責任を果たす必要がある。金融機関が自らの利用する AIの学習プロセスや判断根拠を説明できない場合、規制当局や利用者などの第三者が取引の意思決定プロセスを把握することが困難となる恐れがある。そうなれば、金融機関の業務の透明性は損なわれ得る。」(「金融機関における AI 利用の促進に向けた論点整理 」https://www.fsa.go.jp/frtc/kikou/2024/20240528.pdf)。

この問題に対して、「本実証実験の主な目的である法的論点の整理は次のとおりである。本実証実験は、金融機関がコンプラ違反確認業務において、AI による判定基準や学習済みモデルの確認周期を独自に設定した上で、当該 AI による一次確認を行うものである。この運用が、法令ならびに主要行等向けの総合的な監督指針および金融商品取引業者等向けの総合的な監督指針(以下、監督指針等)の規定に抵触しないか問題となった。

この点、適切な運用がなされていれば、法令および監督指針等上、金融機関によるコンプラ違反確認業務に関し、AI による一次確認を介することに特段問題はないと考えられる旨を金融庁は回答した。適切な運用とは、具体的には、AI による判定基準や学習済みモデルの信頼性に関する検証を合理的な方法・間隔で行うこと等を指す。」(「金融機関における AI 利用の促進に向けた論点整理 」https://www.fsa.go.jp/frtc/kikou/2024/20240528.pdf)

すなわち、ブラックボックスの部分について、適切な運用を行うということで、フロー全体の適切性についての説明責任を果たしているものと解することができます。AIの活用に当たっては、ユースケースの中での適切な運用、検証を適切に行う仕組みによって合理的な説明が担保できる体制の構築が、納得感のキーになります。

3「チャレンジしないリスク」を超える

このディスカッションペーパーは初期的な論点の紹介を目的としていますから、リスクばかりが紹介されている文書に見えなくはありません。

かといって、リスクの前で足踏みをしていると生成AIの可能性がもたらすメリットを十分に享受できない「チャレンジしないリスク」に陥ることになります。すでに方針と取り組み事例が金融庁から示されているのですから、努力の方向性については明らかにされつつある状況といえます。

たとえば、有識者会議報告書では、「 中長期的な取組みとして、保険金支払査定において AI を利用するなどして客観化を図ることにより、支払管理部門に対する営業部門の影響を排除すべき、といった指摘もある。」(脚注17(https://www.fsa.go.jp/singi/sonpo/houkokusyo.pdf))など、支払管理部門と営業部門の関係性の是正、パワーバランスの調整役としての役割など、期待される役割は非常に多く、業務効率化にとどまらない、ますます利用される場面が広がっていくことは確実です。

本ディスカッションペーパーを踏まえ、官民ステークホルダー勉強会が6月から開催され、今後も更新版が出る予定となっており、そちらも追っていくことが必要です。

執筆者プロフィール

-

株式会社Hokanグループ 弁護士/パブリック・アフェアーズ室長

兼コンプライアンス室長

2008年慶應義塾大学法科大学院卒業、2009年弁護士登録(東京弁護士会)。都内法律事務所・損害保険会社・銀行を経て、株式会社hokanに入社。平成26年保険業法改正時には、保険会社内で改正対応業務に従事した経験を持つ。「「誠実義務」が求める保険実務におけるDXの方向性(週刊金融財政事情 2024.9.17)」、「実務担当者のための今日から始める保険業法改正対応」(保険毎日新聞 2025.5.15~7.3)等を執筆。

関連記事

hokan®︎の資料はこちら!